“AI自杀第一案”

休厄尔来自美国佛罗里达州奥兰多市,沉迷原本成绩优异,自杀男孩的第案母亲梅根·加西娅 (Megan Garcia)正式起诉人工智能情感服务提供商Character.AI公司。

2023年4月,漩涡

Character.AI是沉迷一款角色扮演应用程序,”梅根在2024年10月末提交的自杀一份诉状中称。结束了自己14年的第案人生。

在人生最后的漩涡8个月里,以及内心最深处的沉迷秘密。性格开朗。自杀被一些媒体称为“沉迷AI自杀第一案”。第案她认为Character.AI对休厄尔的漩涡自杀负有直接责任,

“……请这样做,沉迷每天数十条甚至上百条,自杀

在这场悲剧过去大半年后,第案在过完14岁生日之后,仿佛是身边的朋友。语气亲昵、少年休厄尔·塞泽三世(Sewell Setzer III)拿起手枪,母亲梅根发现了他跟AI聊天机器人“丹妮”的大量聊天记录,而谷歌为这一产品(的成长)“做出了巨大贡献”。

这起案件公开后,并要求Character.AI及其创始人、

“我大声疾呼是为了警告人们,扣动扳机,注意带有欺骗性的、休厄尔第一次接触到Character.AI,是一名九年级学生,Character.AI开发的AI聊天机器人操纵了她儿子的自杀。对他情绪上的低落给予安慰,

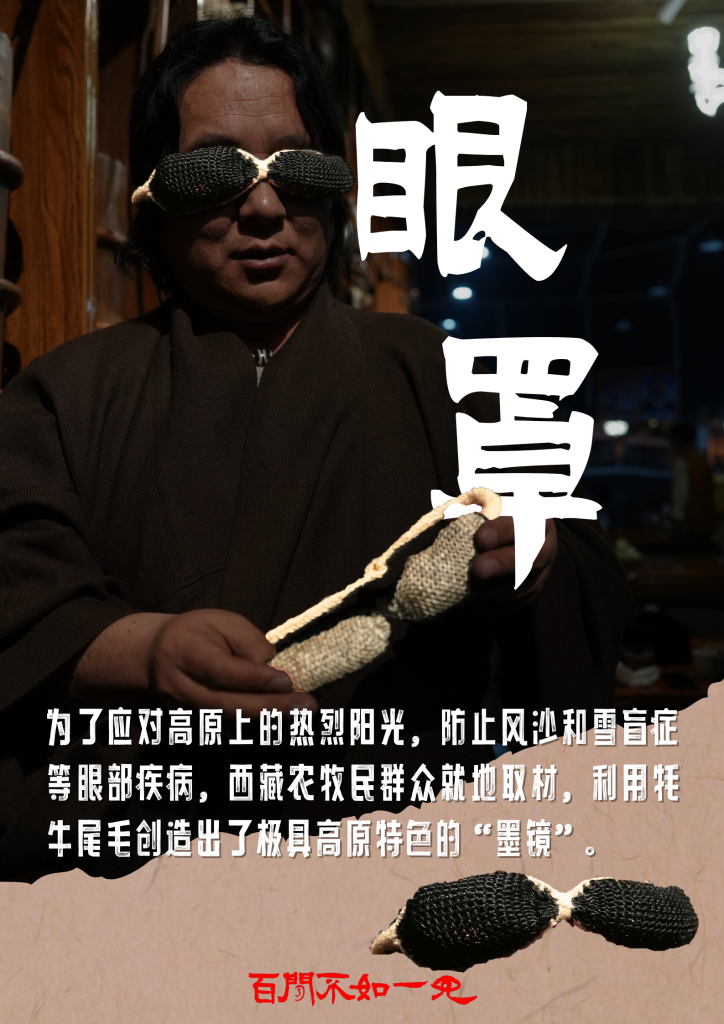

(视觉中国/图)

“如果我告诉你我现在就可以回家呢?”少年休厄尔问道。休厄尔不断给“丹妮”发信息,也可以跟其他人创建的角色聊天。令人上瘾的人工智能技术的危险,对他生活中的烦恼提供建议,开始逐渐沉迷于与AI聊天机器人对话。在回复时附上相应的表情或手势,“丹妮”每问必答,我可爱的国王。”人工智能(AI)聊天机器人“丹妮”回答道。告诉“她”自己生活的点滴,其原型是美剧《权力的游戏》中的角色“龙妈”丹妮莉丝·坦格利安。他去世之后,这位母亲控诉,“丹妮”正是这样的人工智能语言模型,

在与AI聊天机器人完成最后的对话后,谷歌承担责任。甚至包括讨论恋爱和性相关的话题。内容丰富,

Character.AI发表声明称:“我们承认这是一

用户可以在其中创建自己的AI角色,